免费提供 github 热搜历史数据,后台回复 邮箱 即可

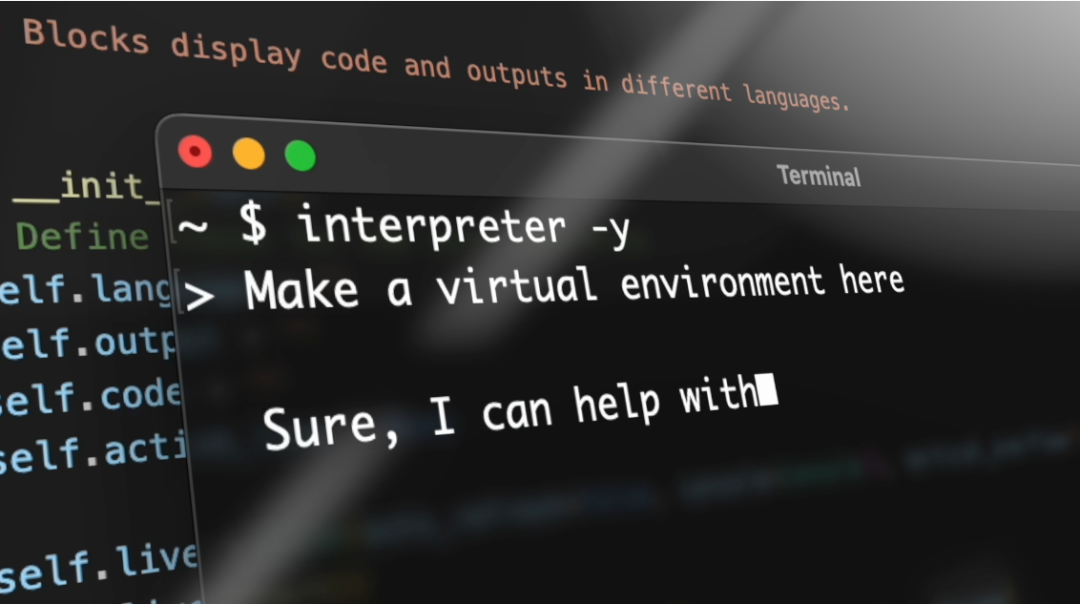

Open Interpreter(开放解释器)可以让大语言模型(LLMs)在本地运行代码(比如 Python、JavaScript、Shell 等)。安装成功后,在终端上运行$interpreter,就可以通过类似 ChatGPT 的界面与 Open Interpreter 聊天,完成对电脑的控制。

通过开放解释器的聊天界面,我们可以完成很多的日常操作,比如:

-

创建和编辑照片、视频、PDF 等

-

控制 Chrome 浏览器进行搜索

-

绘制、清理和分析大型数据集

-

…

⚠️ 注意:在代码运行前都会要求批准执行代码。

下面的视频是演示 DEMO:

OpenAI 发布的 Code Interpreter 和 GPT-4,为我们提供了一个使用 ChatGPT 完成实际任务的绝佳机会。

但是,OpenAI 的服务是托管的,闭源的,并且受到严格限制,比如:

-

无法访问互联网。

-

预装软件包数量有限。

-

允许的最大上传为 100 MB,且最大运行时间限制为 120.0 秒

-

当运行环境中途结束时,之前的状态会被清除(包括任何生成的文件或链接)。

与 OpenAI 相比,Open Interpreter(开放解释器)通过在本地环境中运行克服了这些限制。它可以完全访问互联网,不受运行时间或是文件大小的限制,也可以使用任何软件包或库。它实现了将 GPT-4 代码解释器的强大功能与本地开发环境的灵活性相结合。

Open Interpreter(开放解释器)使用和安装非常的简单,通过 pip 就可以完成安装

pip install open-interpreter常用操作命令展示:

交互式聊天

要在终端中开始交互式聊天,从命令行运行 interpreter:、

interpreter或者从.py 文件中运行 interpreter.chat():

interpreter.chat()程序化聊天

为了更精确的控制,您可以通过 .chat(message) 直接传递消息 :

interpreter.chat("Add subtitles to all videos in /videos.")# ... Streams output to your terminal, completes task ...interpreter.chat("These look great but can you make the subtitles bigger?")# ...

开始新的聊天

在 Python 中,Open Interpreter 会记录历史对话。如果你想从头开始,可以进行重置:

interpreter.messages =保存和恢复聊天

messages = interpreter.chat("My name is Killian.") # 保存消息到 'messages'interpreter.messages = [] # 重置解释器 ("Killian" 将被遗忘)interpreter.messages = messages # 从 'messages' 恢复聊天 ("Killian" 将被记住)

自定义系统消息

你可以检查和配置 Open Interpreter 的系统信息,以扩展其功能、修改权限或赋予其更多上下文。

interpreter.system_message += """使用 -y 运行 shell 命令,这样用户就不必确认它们。"""print(interpreter.system_message)

更改模型

Open Interpreter 使用LiteLLM连接到语言模型。

您可以通过设置模型参数来更改模型:

interpreter --model gpt-3.5-turbointerpreter --model claude-2interpreter --model command-nightly

在 Python 环境下,您需要手动设置模型:

interpreter.llm.model = "gpt-3.5-turbo"在本地运行 Open Interpreter(开放解释器)

interpreter --local调试模式

为了帮助贡献者检查和调试 Open Interpreter,–verbose 模式提供了详细的日志。

您可以使用 interpreter –verbose 来激活调试模式,或者直接在终端输入:

interpreter...%verbose true> %verbose false

由于生成的代码是在本地环境中运行的,因此会与文件和系统设置发生交互,从而可能导致本地数据丢失或安全风险等意想不到的结果。

安全提示

由于生成的代码是在本地环境中运行的,因此会与文件和系统设置发生交互,从而可能导致本地数据丢失或安全风险等意想不到的结果。

⚠️ 所以在执行任何代码之前,Open Interpreter 都会询问用户是否运行。

您可以运行 interpreter -y 或设置 interpreter.auto_run = True 来绕过此确认,此时:

-

在运行请求修改本地文件或系统设置的命令时要谨慎。

-

请像驾驶自动驾驶汽车一直握着方向盘一样留意 Open Interpreter,并随时做好通过关闭终端来结束进程的准备。

-

考虑在 Google Colab 或 Replit 等受限环境中运行 Open Interpreter 的主要原因是这些环境更加独立,从而降低执行任意代码导致出现问题的风险。

![【学习强国】[挑战答题]带选项完整题库(2020年4月20日更新)-武穆逸仙](https://www.iwmyx.cn/wp-content/uploads/2019/12/timg-300x200.jpg)

![【学习强国】[新闻采编学习(记者证)]带选项完整题库(2019年11月1日更新)-武穆逸仙](https://www.iwmyx.cn/wp-content/uploads/2019/12/77ed36f4b18679ce54d4cebda306117e-300x200.jpg)