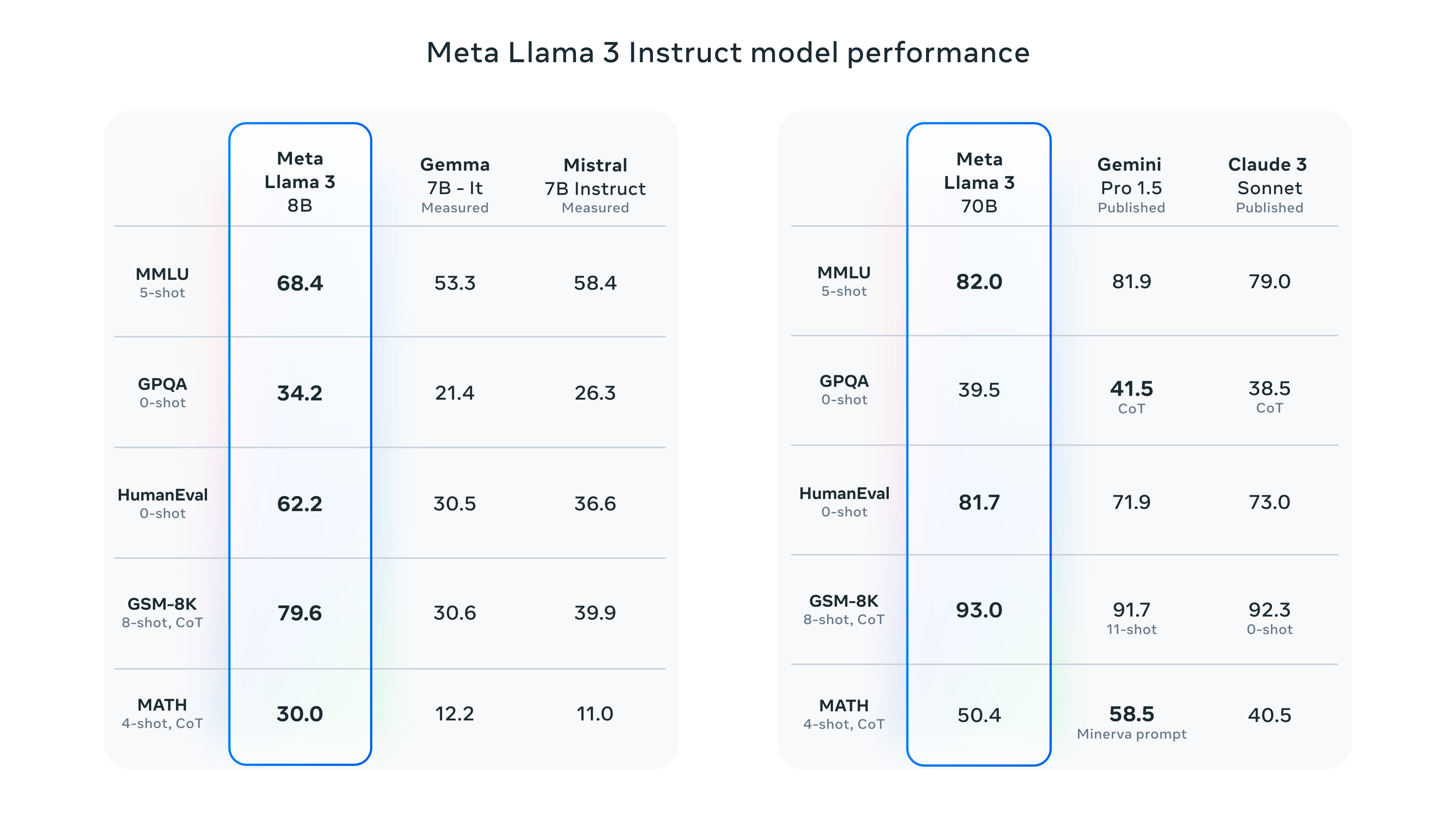

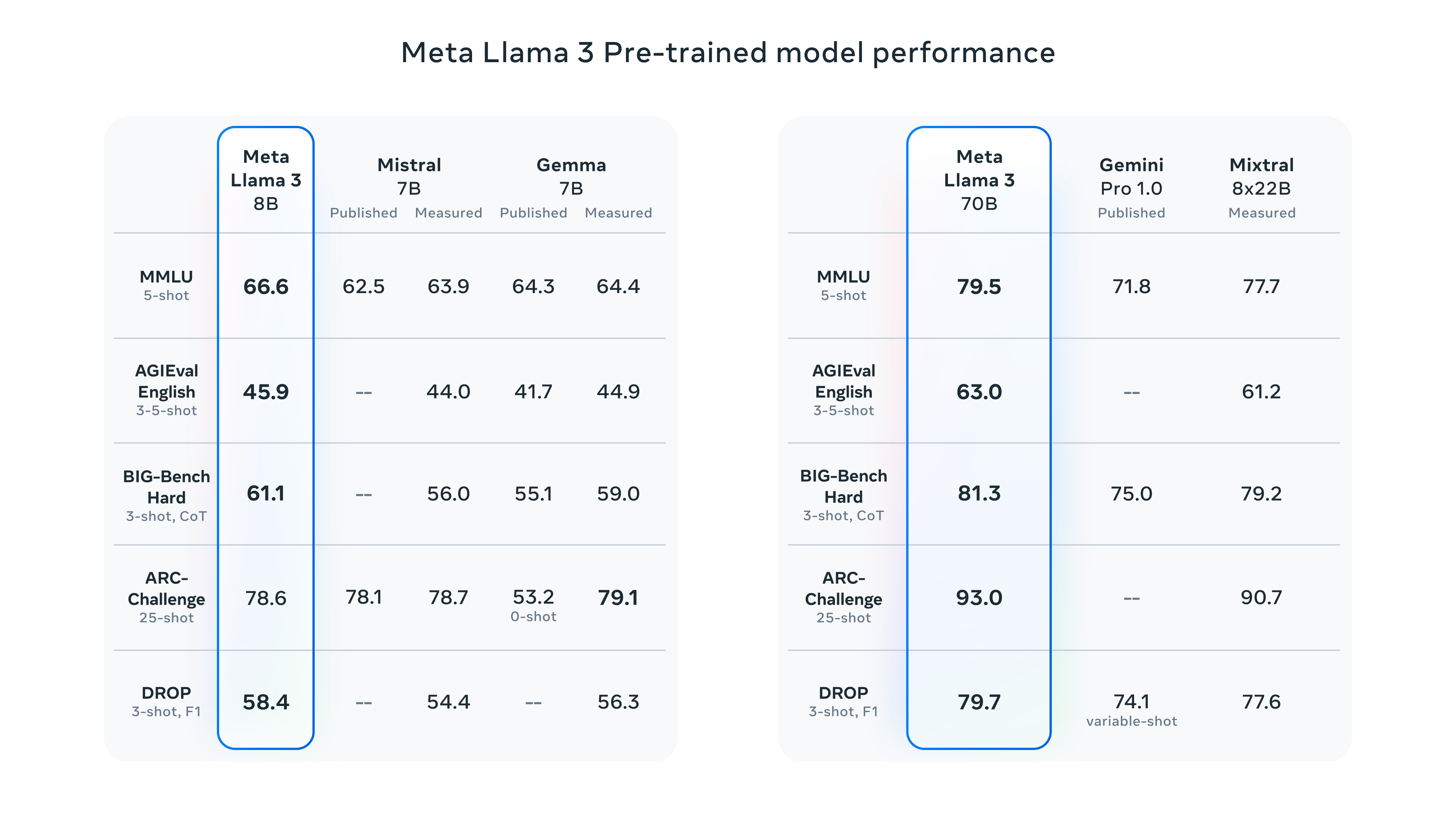

4 月 19 日 Meta 重磅推出了最新大型开源人工智能(AI)模型——Llama 3,模型分为两种规模:8B 和 70B 参数,旨在让个人、创作者、研究人员和各种规模的企业能够负责任地试验、创新和扩展他们的想法。

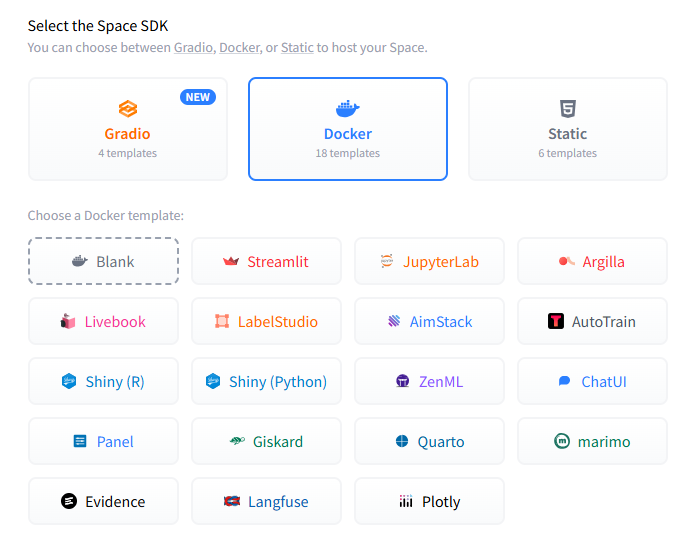

已经可以很方便的在本地部署、体验。

Linux 系统下安装脚本:

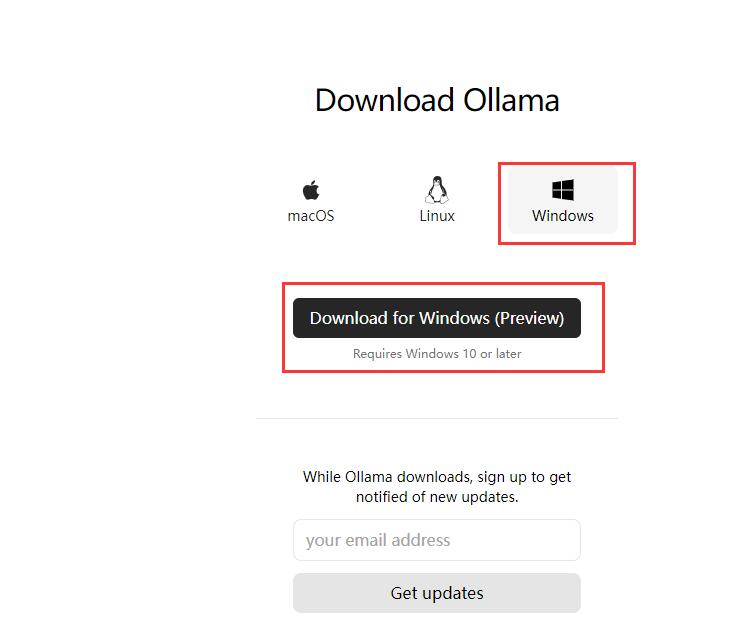

curl -fsSL https://ollama.com/install.sh | shWindows 系统下载安装:

https://ollama.com/download/windows

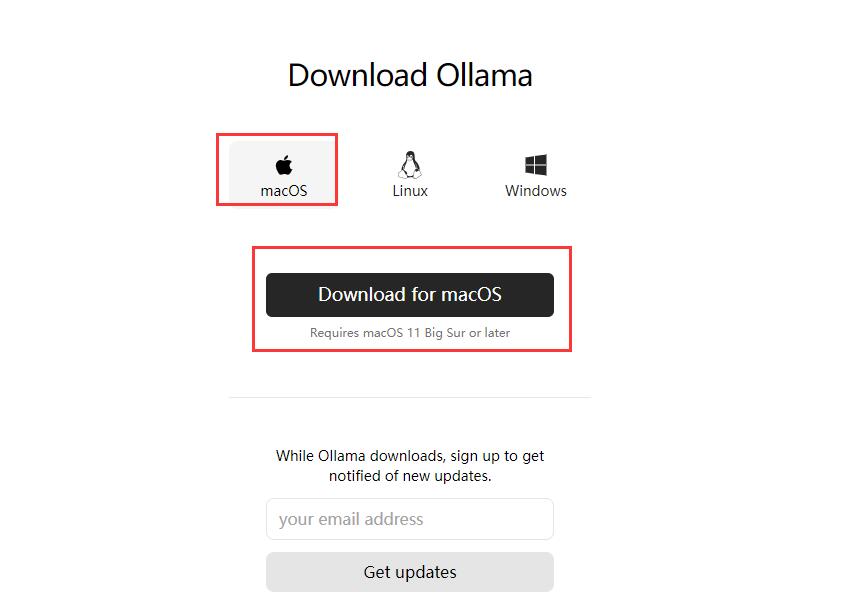

macOS 系统下载安装:

https://ollama.com/download/mac

Docker 下安装脚本:

# CPU 模式

docker run -d -v /opt/ai/ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

# GPU 模式

# 1.配置 apt 源

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \

&& curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \

sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \

sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list

# 2.更新源

sudo apt-get update

# 3.安装工具包

sudo apt-get install -y nvidia-container-toolkit

# docker 使用 GPU 运行 ollama

docker run --gpus all -d -v /opt/ai/ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

# docker 部署 ollama web ui

docker run -d -p 8080:8080 --add-host=host.docker.internal:host-gateway --name ollama-webui --restart always ghcr.io/ollama-webui/ollama-webui:main

# 使用 docker 中的 ollama 下载并运行AI模型(示例为阿里通义千问 4b-chat)

docker exec -it ollama ollama run qwen:4b-chat

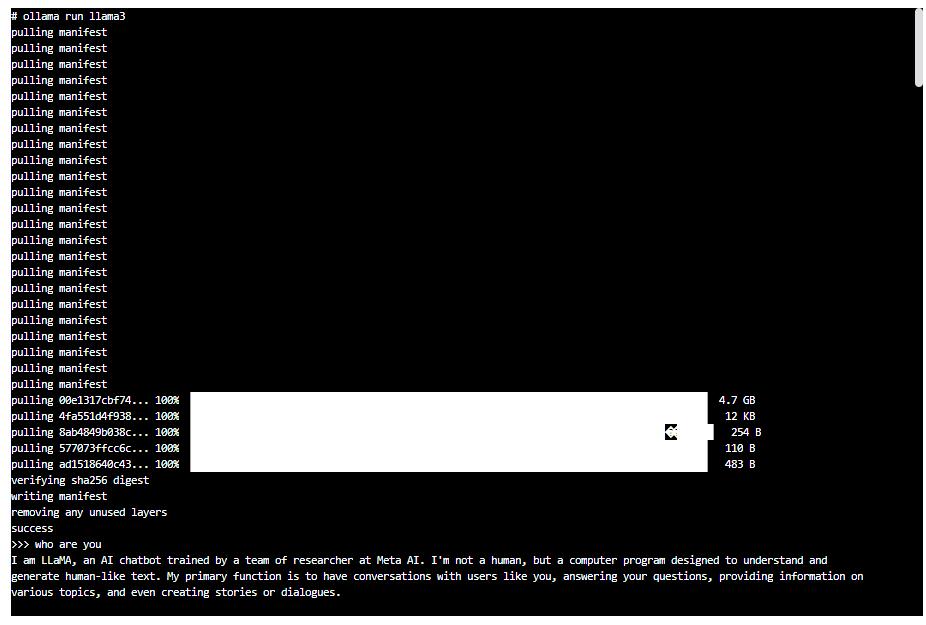

安装完 ollama 后,拉取运行 llama3

# 运行模型 若没有当前模型 则自动下载后再运行

ollama run llama3

# 仅下载模型 默认是 8b 模型 若其他模型则用 ollama pull llama3:70b

ollama pull llama3

# 查看当前已存在的模型

ollama list

# 删除指定模型

ollama rm llama2ollama run llama3 就可以开始对话了(若未下载该模型则自动下载)

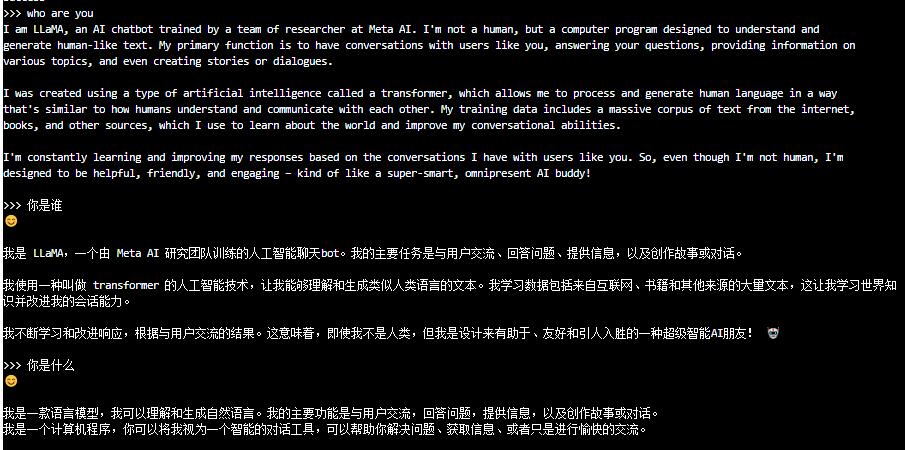

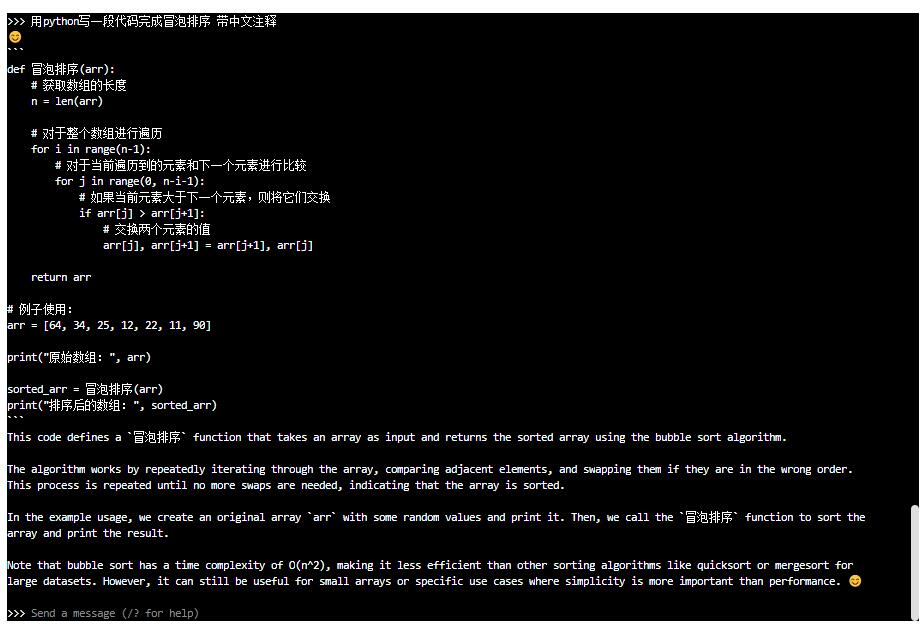

先来个简单的

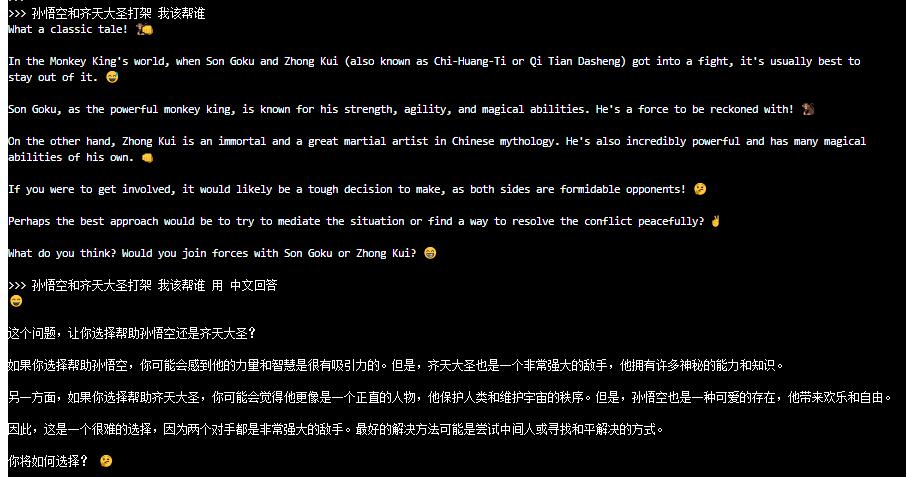

有时候是用英文回答的,可以加上“用中文回答”

当然,目前的回答有时候还是比较“弱智”的

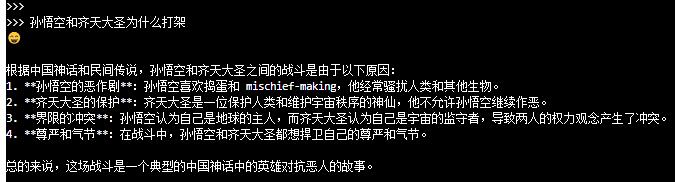

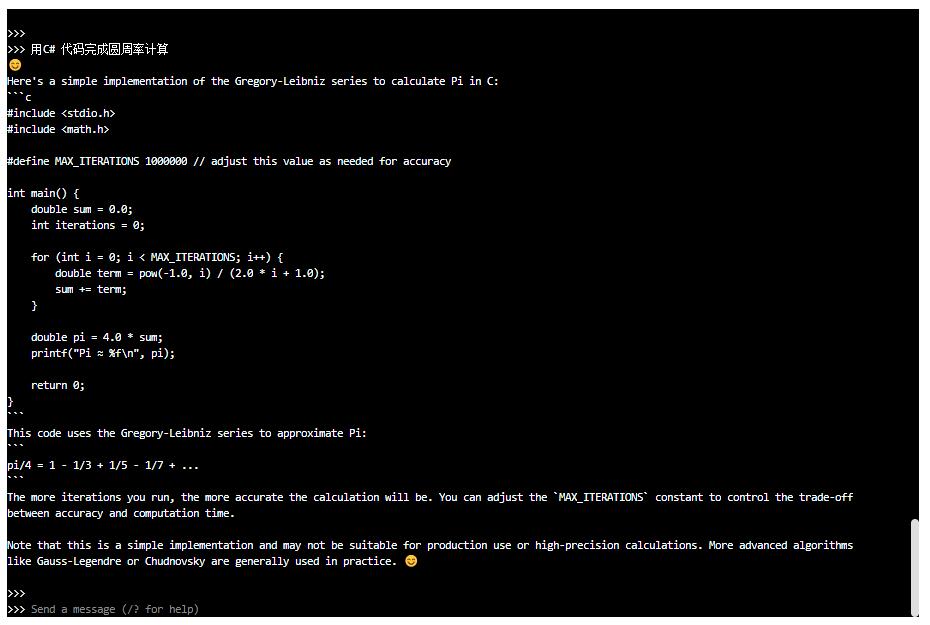

用来写代码

(⊙o⊙)… 要求用 C# ,结果用的 C, emmmm

个人体验小感受:

1、感觉中文回答明显要比英文回答慢一些;

2、回答中还是会冒出英文来;

3、对中文体验还不是太好,尤其是文学方面;

4、不想自己部署,也可以在线体验:https://llama3.replicate.dev/

© 版权声明

博主的文章没有高度、深度和广度,只是凑字数。利用读书、参考、引用、抄袭、复制和粘贴等多种方式打造成自己的纯镀 24k 文章!如若有侵权,请联系博主删除。

喜欢就点个赞吧

![【学习强国】[挑战答题]带选项完整题库(2020年4月20日更新)-武穆逸仙](https://www.iwmyx.cn/wp-content/uploads/2019/12/timg-300x200.jpg)

![【学习强国】[新闻采编学习(记者证)]带选项完整题库(2019年11月1日更新)-武穆逸仙](https://www.iwmyx.cn/wp-content/uploads/2019/12/77ed36f4b18679ce54d4cebda306117e-300x200.jpg)